Meta ha presentado oficialmente su nueva generación de modelos de lenguaje Llama 4, en una apuesta que consolida su posición en el competitivo panorama de la inteligencia artificial.

La compañía liderada por Mark Zuckerberg lanza así tres versiones: Llama 4 Scout, Llama 4 Maverick y Llama 4 Behemoth, con un enfoque claro en la computación multimodal y la eficiencia algorítmica. La empresa confirma que Scout y Maverick estarán disponibles como software de código abierto, mientras que Behemoth se encuentra aún en fase de entrenamiento.

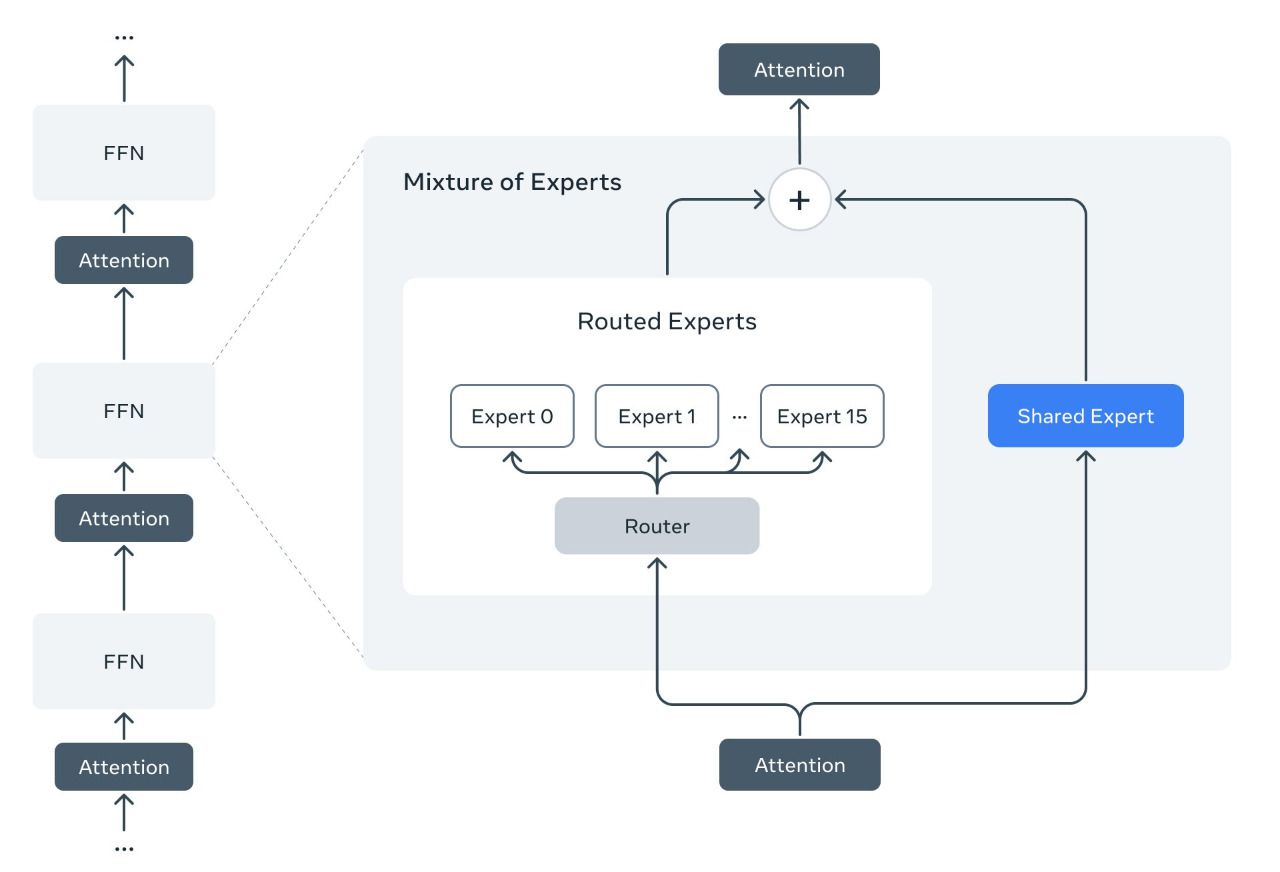

Arquitectura basada en expertos para mayor eficiencia

A diferencia de generaciones anteriores, Llama 4 introduce por primera vez una arquitectura basada en mixture of experts (MoE), una técnica que asigna tareas a submodelos especializados para optimizar el rendimiento y el uso de recursos. En esta configuración, los modelos no activan todos sus parámetros en cada consulta, sino solo aquellos necesarios para resolver tareas específicas.

Llama 4 Maverick, por ejemplo, cuenta con 400.000 millones de parámetros totales, aunque únicamente activa 17.000 millones de ellos, distribuidos entre 128 expertos. Por su parte, Scout también activa 17.000 millones de parámetros, pero repartidos entre solo 16 expertos. Esta configuración reduce la carga computacional y permite respuestas más rápidas y especializadas.

Capacidades técnicas y enfoque multimodal

Meta ha subrayado que Llama 4 es su línea de modelos “más avanzada hasta la fecha”, destacando especialmente sus capacidades multimodales. Este enfoque permite procesar texto, imagen, audio y vídeo de forma integrada, una funcionalidad clave en el desarrollo de asistentes virtuales más completos y versátiles.

Llama 4 Scout se especializa en tareas como el resumen de documentos y el análisis de bases de código extensas. Su ventana de contexto de 10 millones de tokens permite manejar entradas muy largas, lo que lo hace ideal para aplicaciones en ámbitos como la documentación técnica o la automatización de procesos complejos.

En cuanto a Maverick, Meta lo plantea como un competidor directo de modelos como GPT-4o de OpenAI o Gemini 2.0 de Google. Está diseñado como un asistente general capaz de abordar escritura creativa, codificación, razonamiento multilingüe e interpretación de imágenes. Según pruebas internas de Meta, supera a estos modelos en ciertos benchmarks relacionados con procesamiento contextual y razonamiento, aunque queda por detrás de versiones más recientes como Gemini 2.5 Pro o Claude 3.7 Sonnet.

Behemoth, aún en fase de desarrollo, aspira a ser uno de los modelos más potentes del mercado con casi dos billones de parámetros. Meta asegura que, en pruebas STEM, ha superado a GPT-4.5, Claude 3.7 y Gemini 2.0 Pro.

Despliegue limitado

A pesar del entusiasmo técnico, el despliegue de Llama 4 no será global. Meta ha indicado que, por el momento, las funciones multimodales solo están disponibles en inglés y dentro de Estados Unidos. En plataformas como WhatsApp, Messenger e Instagram, ya se está utilizando Llama 4 en 40 países, aunque la Unión Europea no figura entre ellos debido a las restricciones legales.

La legislación comunitaria sobre inteligencia artificial y protección de datos impide tanto el uso como la distribución de los modelos en el territorio europeo. Además, las corporaciones con más de 700 millones de usuarios mensuales deberán solicitar una licencia especial para poder implementar esta tecnología.